最近AI生图开始卷起来了, 先是F.1 Kontext发布,把一致性拉满了。而且还有大神已经搞出来了使用F.1 Kontext多参出图的工作流。

接着就是豆包和即梦也跟着更新了生图生视频的模型。目前虽然不能多参出图,但是一句话改图,以及一致性和F.1 Kontext差不多。而且对于中文的生成修改能力可以说只此一家。

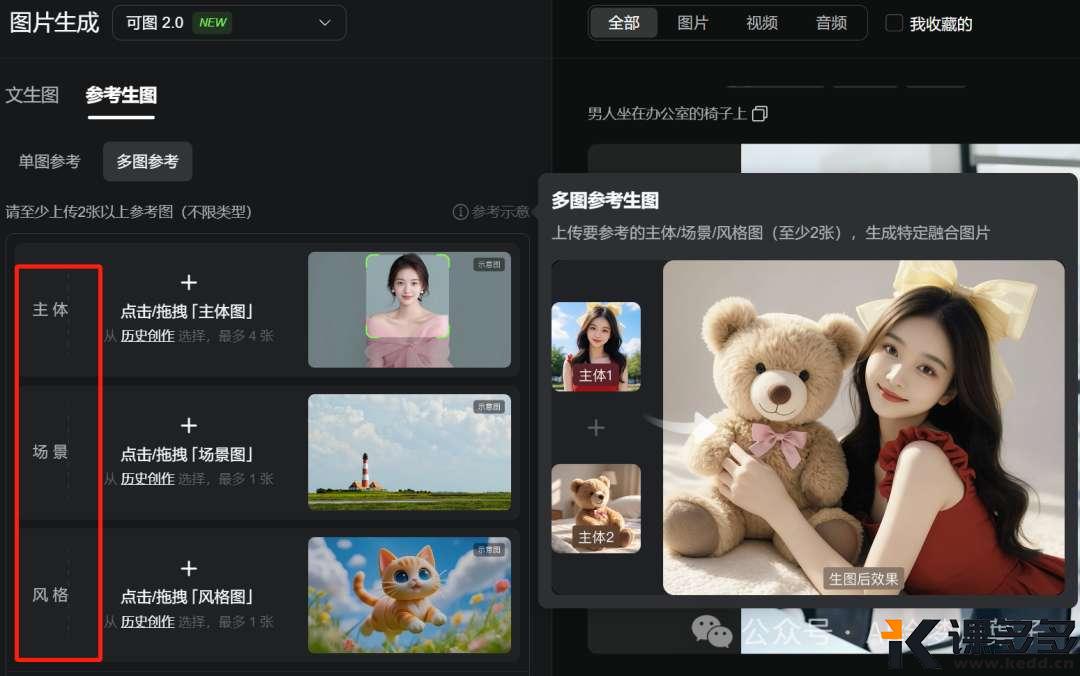

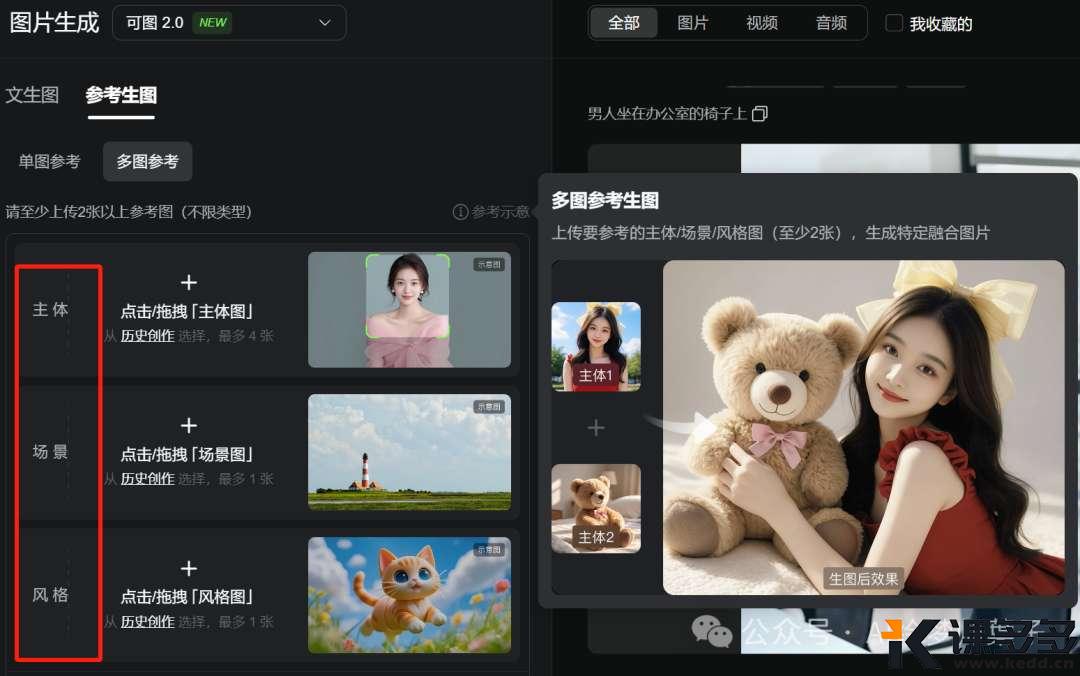

现在可图也坐不住了,立马上线了多参出图。

可以同时参考主题、场景、风格,进行参考出图。

是不是很熟悉?

确实,这个功能在视频上更早出现。比如Vidu、Pix、可灵等等。

在我们生成视频时起到了很大的帮助。

比如:我们抽卡抽到了一张很好的场景图,也已经有了人物主体。

我们就不用再花功夫把人物P到场景里,再用图生视频。直接使用多参就可以让人物在场景中移动。

再比如:我们希望两个人在一个场景互动,但是AI很难把两个人的角色一致性做好。

我们也可以使用多参直接生成视频,让两个人直接进入场景中互动。

这个多参功能,也造就了多参宗的辉煌。

但使用多参抽卡确实需要不少时间,参考的内容越多。越容易导致生成的内容不符合要求。而且视频抽卡需要花费的时间、金钱也会更多。

现在有了多参出图,我们就可以快速的建构场景画面,节约时间的同时,也更省钱。

可图2.0多参出图,至少需要上传两张参考图。多的话四张、五张都可以。

(场景和风格只可以上传一个,主体可以1-4张)

看看实际生成的效果:

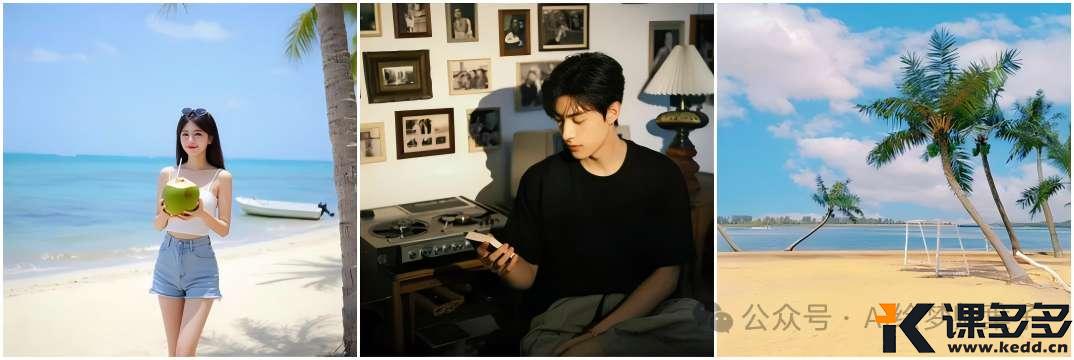

一、双图:主体+场景

提示词:女孩奔跑在海上,

提示词:女孩奔跑在海上,现实插画

二、三图:双主体+场景

提示词:女生和男生并肩坐在沙滩上

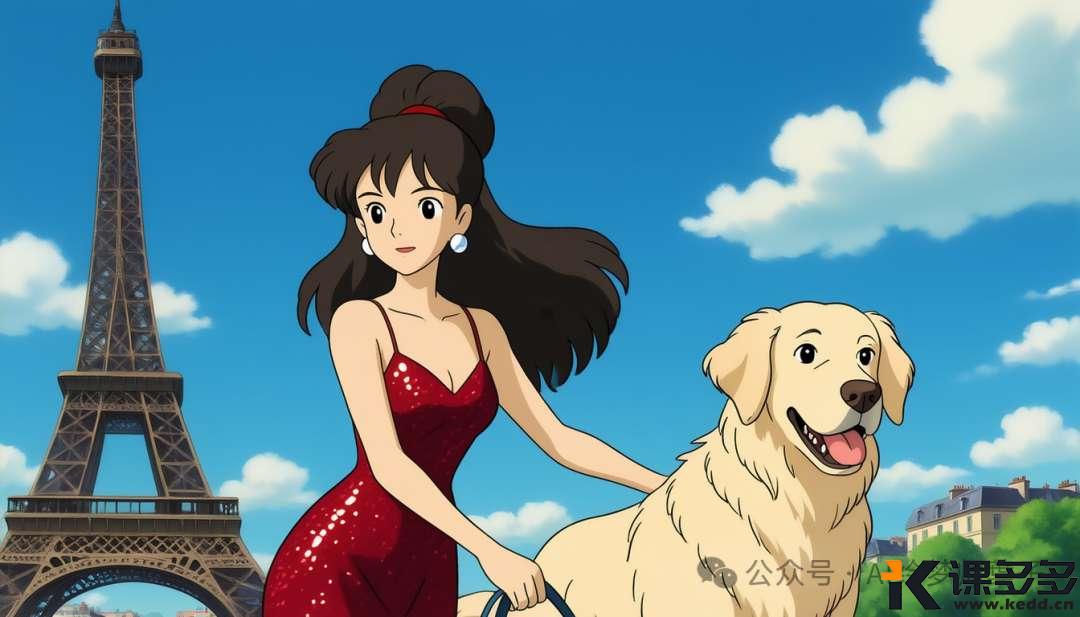

三、四图:双主体+场景+风格

提示词:女生牵着一条狗狗在埃菲尔铁塔下漫步

四、五图:四主体+场景

提示词:小鸭子穿着比基尼戴着墨镜,躺在游泳圈里

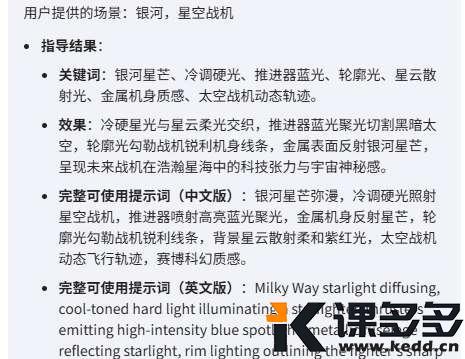

六、小技巧

1、相同人物,不同场景。 (适合制作故事短片)

只需要改变不同的场景图片。

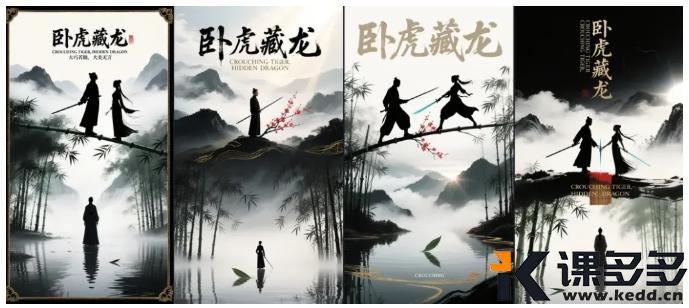

2、相同角色,不同风格。(适合制作创意片)

只需要改变参考风格图片。或者提示词中进行风格描述。

3、相同角色,相同场景,不同动作。(适合连贯镜头)

提示词中进行动作姿势的控制。

PS: 上传人物主体,尽量使用纯色背景、单一主体的图片。

如果是多人图片,可以使用框选,进行人物选择。

以上就是关于可图2.0的多参生图的使用方法了。

大家有想要制作的新短片吗?赶快搞起来吧。

暂无评论内容